桑德尔主讲的哈佛公开课《公平与正义》中有一个案例几年前流传很广:你在驾驶一辆列车,刹车系统失灵,前方轨道上有五个人,继续行驶的话很快会撞死他们,但这时可以转弯到另一条轨道上,那里只有一个人。撞死五个人或者撞死一个人,你会怎么选择?

桑德尔是著名的美国左派学者(文化自由,经济保守),也就是俗话说的「白左」,关注环保、平权等一系列议题。这些人在外交上主张文化融合,主要观点包括接受中东难民,显然这已经在网上受到了极大的非议;经济上则主张限制大企业的贪婪,提高最低工资,这又常常被右派讽刺为「不懂经济的圣母」。

「总是忽视现实,而去思考一些幼稚的道德问题」——这是右派,特别是国内「精致利己主义右派」给白左的定调。

《Top Gear》曾有一期节目提到了自动驾驶,并且假设了一个场景:

一台自动驾驶汽车,行驶中前方突然出现一台胡乱骑行的自行车,要想不去伤害骑行者,就必须要切换到快车道,而切过去则有可能与后方高速行驶的车辆相撞,害死自己和快车道车辆中的驾驶者,那么——这个时候自动驾驶的逻辑应该设定为切换车道还是不要切换车道?

另一位主持人在这个题面上给出了一个更有冲击力的变量,假如突然出现在前方的不是一个自行车,而是一个未成年的小女孩,这时候自动驾驶的逻辑应该是切换车道还是不要切换车道?

当自动驾驶面对这样的道德难题时,就没有人能再说桑德尔在《公平与正义》公开课中提出的那个悖论是「幼稚」和「不切实际」的了。

科技的结果之一就是让人类拥有更强的能力,而这个结果所对应的,就是更大的责任。

好的答案总是来自好的问题。恰恰是那些预想到科技的结果,并且从一开始就拥有这样「幼稚而不切实际」的责任感的人,才能够找到科技的原因。

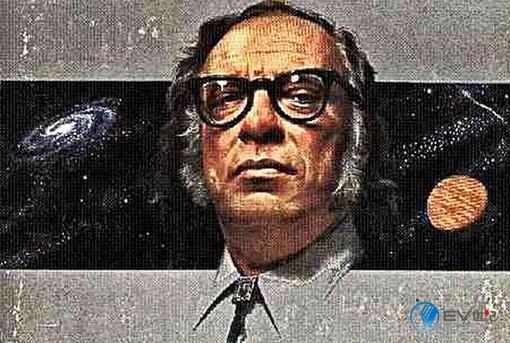

阿西莫夫,科幻小说家

阿西莫夫在他的《机器人》、《基地》及《银河帝国》系列里,提出了这样的假设:机器人拥有控制人类思想的能力,因此只要找到关键的人,就能够改变人类未来的命运。这种假设的基础在于,不论人类智慧里有多少情感的因素,但终归是大脑运算的结果,这种运算是可以被数字化的,甚至可以通过调整变量(情感操纵)对最终决策施以影响。

思考的终极形态被简化成信息与运算。

在上个月围棋人机大战的最终战役上,中国天才棋手柯洁九段以0:3的比分完败给AlphaGo,在单纯理性的智慧方面,人类在一些领域中已经丝毫无法抵抗人工智能,而且是毫无还手之力的彻底失败。

因此不妨假设,在未来的某一天,我们的哲学、道德会否也要面对人工智能的挑战?那些哲学先贤所寻觅不得,那些左或右争论不下的命题,或许要由人工智能给出人类给不出的最理想的答案?

比如:「我和你妈同时掉水里了,你先救谁?」